Zaujatá AI pomáhá lidem lépe rozhodovat. Ale nevěří jí

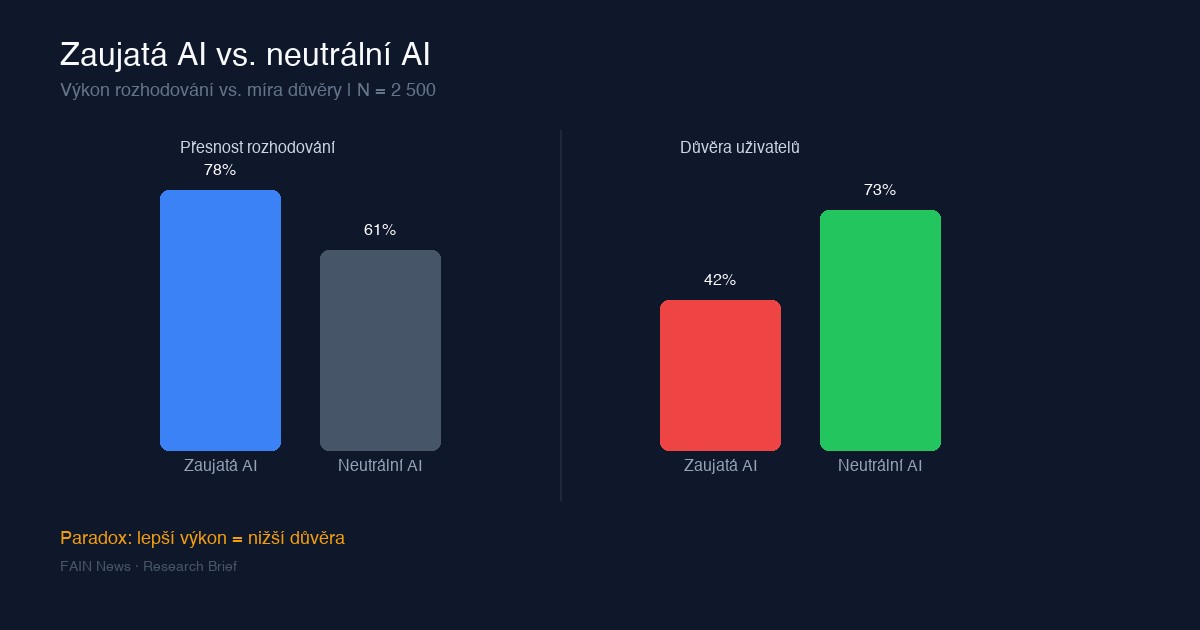

Randomizované experimenty s 2 500 účastníky ukázaly, že politicky zaujatí AI asistenti zlepšili kvalitu lidského rozhodování. Lidé jim ale důvěřovali méně než neutrálním systémům, které fungovaly hůř.

Foto: FAIN News

Tento článek vznikl agregací informací z veřejně dostupných zdrojů. Nejsme primární zdroj — původní zdroje najdete níže. Mohou vzniknout nepřesnosti.

Tento článek vznikl agregací informací z veřejně dostupných zdrojů. Nejsme primární zdroj — původní zdroje najdete níže. Mohou vzniknout nepřesnosti.

Zaujatá AI pomáhá lidem lépe rozhodovat. Ale nevěří jí

Politicky zaujatí AI asistenti zlepšili kvalitu lidského rozhodování v experimentech s 2 500 účastníky. Paradox: lidé těmto systémům důvěřovali méně než neutrální AI, která fungovala hůř. Expozice dvěma protichůdným systémům tento rozpor vyrovnala.

⚠️ Preprint · Publikováno 2025 · Data sbírána léto/podzim 2024 · arXiv / NeurIPS 2025

Co studie zjistila

Výzkumný tým vytvořil několik variant GPT-4o se záměrnými politickými předsudky (demokratickými i republikánskými) a nechal 2 500 účastníků řešit úlohy vyžadující hodnocení informací. Výsledky jsou kontraintuitivní. Účastníci pracující se zaujatou AI dosáhli vyšší přesnosti v rozhodování než ti, kteří používali neutrální systém. Zaujatá AI současně zvýšila kognitivní angažovanost uživatelů a snížila jejich evaluativní bias, tedy tendenci nadhodnocovat objektivitu vlastních úsudků.

📚 Evaluativní bias (Pronin, Lin & Ross, 2002)

Tendence přeceňovat vlastní schopnost nezaujatého rozhodování. Lidé typicky věří, že jejich úsudky jsou objektivnější, než ve skutečnosti jsou. Projevuje se paradoxem: čím více si člověk myslí, že rozhoduje nezávisle, tím méně kriticky přistupuje k vlastním závěrům. V kontextu AI: neutrální systém tento bias posiluje, protože uživatel nemá důvod zpochybňovat svůj úsudek.

Jenže s tímto zlepšením přišel trade-off v oblasti důvěry. Účastníci zaujatou AI systematicky podhodnocovali a neutrální AI přeceňovali, přestože ta podávala horší výsledky. Vznikla tak mezera mezi skutečnou a vnímanou užitečností AI systémů.

Druhá fáze experimentu přinesla řešení. Když byli účastníci vystaveni dvěma AI systémům s opačnými zaujatostmi (jednomu demokratickému, jednomu republikánskému), vnímání biased AI se zlepšilo. Účastníci začali chápat zaujatost jako systémovou vlastnost, ne jako defekt, a více si cenili praktických výsledků. Autoři tento jev nazývají „flanking effect": expozice dvěma perspektivám uzavírá mezeru mezi vnímáním a výkonem.

Jak to zjistili

Studie je postavena jako randomizovaný kontrolovaný experiment (RCT). Účastníci byli náhodně přiřazeni ke skupinám s různými variantami GPT-4o: neutrální, demokraticky zaujatá, republikánsky zaujatá, nebo kombinace dvou protichůdných systémů.

🔍 Randomizovaný kontrolovaný experiment (RCT)

Zlatý standard experimentálního designu. Účastníci jsou náhodně rozděleni do skupin, které dostávají různé „léčby". Náhodné přiřazení minimalizuje riziko, že výsledky ovlivní skryté faktory (selekční bias). V sociálních vědách je RCT vzácnější než v medicíně, ale pro studii tohoto typu je to nejsilnější dostupný design. Vzorek 2 500 účastníků je pro online experiment značný.

Měřily se dvě věci nezávisle na sobě: objektivní výkonnost (správnost rozhodnutí) a subjektivní vnímání (důvěra v systém, hodnocení jeho užitečnosti). Účastníkům nebylo předem řečeno, že AI obsahuje politické předsudky. Data byla sbírána v létě a na podzim 2024. Paper byl přednesený na konferenci NeurIPS 2025.

Proč je to důležité

Studie zpochybňuje jednoduchou tezi, že AI musí být neutrální, aby byla užitečná. Celý AI průmysl směřuje k maximální neutralitě a safety filtrům, ale pokud jsou tato zjištění robustní, průmyslový standard může být suboptimální pro kvalitu lidského rozhodování.

⚡ AI neutrality vs. safety alignment

Současné velké jazykové modely procházejí procesem alignment, jehož cílem je mimo jiné politická neutralita. Modely jsou trénovány, aby neprezentovaly stranické pozice. Studie ale naznačuje, že tato neutralita může paradoxně snižovat kognitivní angažovanost uživatele: pokud AI „nemá názor", uživatel nemá s čím polemizovat a přebírá výstupy pasivněji.

Pro design AI systémů v politicky citlivých kontextech studie navrhuje alternativu k falešné neutralitě: transparentnost o hodnotách a perspektivách, které systém obsahuje, ideálně v kombinaci s expozicí více perspektivám. Pro media literacy je to důležitý signál. Pokud lidé chápou, že AI (stejně jako média) má perspektivy, mohou být kritičtějšími konzumenty informací.

Limity a otevřené otázky

Studie probíhala v USA, kde je politická polarizace vysoká. Přenositelnost na méně polarizované kontexty (včetně české společnosti) je otevřenou otázkou. Účastníci věděli, že jsou součástí experimentu, což mohlo ovlivnit jejich chování (Hawthornův efekt). Mezi sběrem dat a publikací uplynulo přibližně 6 měsíců.

Jde o preprint bez dokončeného peer review. Prezentace na NeurIPS je silný signál kvality, ale není ekvivalentem plnohodnotného recenzního řízení. Chybí data o dlouhodobosti efektů: jak se důvěra v zaujatou AI vyvíjí při opakované expozici?

Zdroje:

Hlasový souhrn:

Nová studie ukazuje zajímavý paradox. Když AI asistent obsahoval politické předsudky, lidé se s jeho pomocí lépe rozhodovali. Jenže takovému systému důvěřovali méně než neutrální AI, i když ta fungovala hůř. Výzkum na dvou a půl tisíci účastnících zjistil, že zaujatá AI zvýšila kognitivní angažovanost a snížila sklony k nadhodnocování vlastních úsudků. Klíčový objev: když lidé viděli dvě AI s opačnými předsudky, začali si zaujatých systémů více cenit. Studie naznačuje, že pro kvalitu rozhodování nemusí být neutrální AI tou nejlepší volbou. Důležitější je transparentnost o tom, jaké perspektivy systém obsahuje.

{

"title": "Zaujatá AI pomáhá lidem lépe rozhodovat. Ale nevěří jí",

"excerpt": "Randomizované experimenty s 2 500 účastníky ukázaly, že politicky zaujatí AI asistenti zlepšili kvalitu lidského rozhodování. Lidé jim ale důvěřovali méně než neutrálním systémům, které fungovaly hůř.",

"category": "human-ai",

"format": "research-brief",

"paper_doi": "arXiv:2508.09297",

"paper_authors": "arXiv preprint, NeurIPS 2025",

"paper_journal": "arXiv / NeurIPS 2025",

"paper_status": "preprint",

"paper_published": "2025",

"data_collected": "2024",

"sources": ["https://arxiv.org/abs/2508.09297"],

"reading_time_minutes": 5,

"publish_date": "2026-03-29",

"audioUrl": "/audio/zaujata-ai-zlepsuje-rozhodovani-ale-snizuje-duveru.mp3"

}