Důvěra v AI není nastavení, ale proces. A většina systémů to ignoruje

Přehledová studie formalizuje, proč statický přístup k důvěře v AI selhává. Calibrated trust vzniká jen tehdy, když se subjektivní důvěra uživatele shoduje s objektivní důvěryhodností systému. Obojí se ale mění v čase, a to různou rychlostí.

Foto: FAIN News

Tento článek vznikl agregací informací z veřejně dostupných zdrojů. Nejsme primární zdroj — původní zdroje najdete níže. Mohou vzniknout nepřesnosti.

Tento článek vznikl agregací informací z veřejně dostupných zdrojů. Nejsme primární zdroj — původní zdroje najdete níže. Mohou vzniknout nepřesnosti.

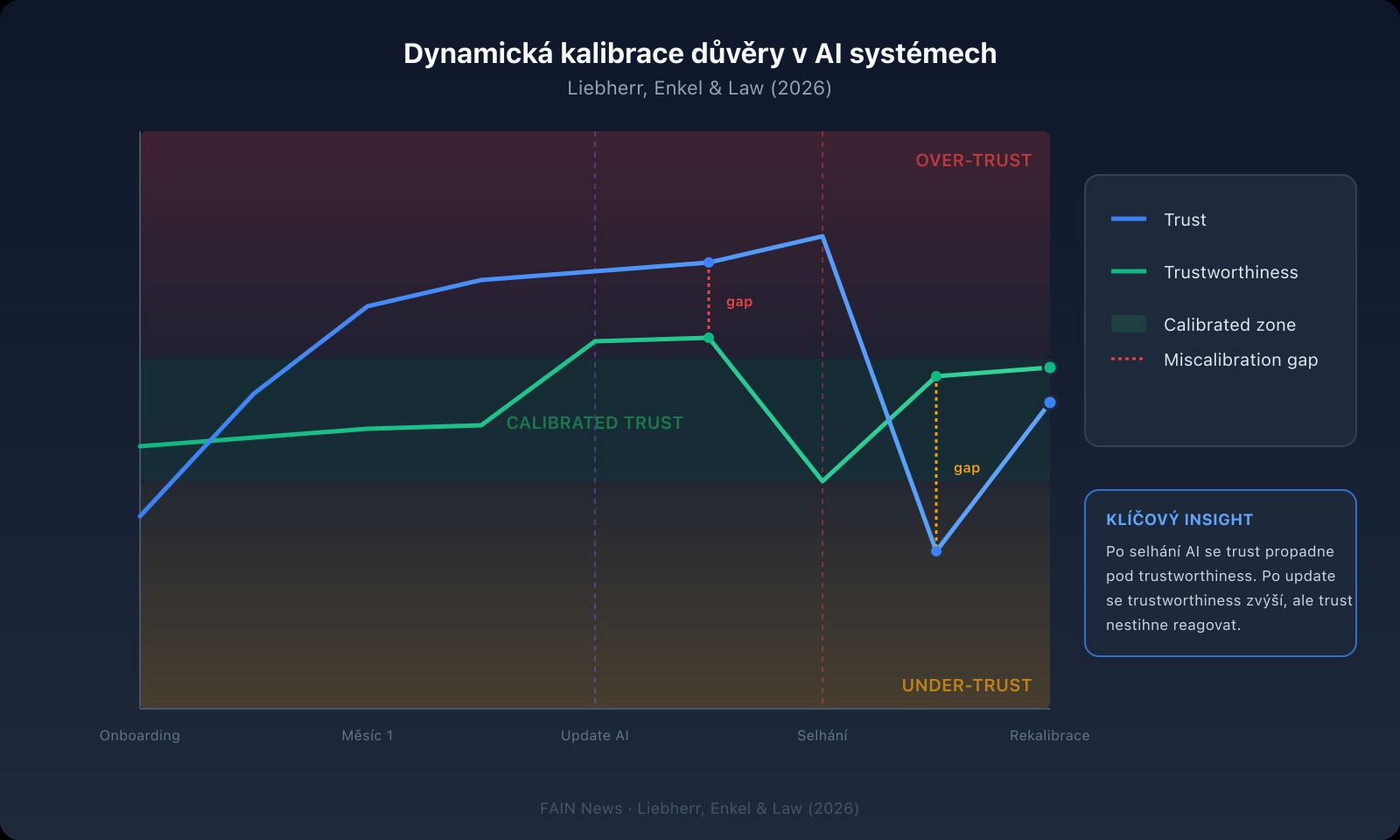

Důvěra uživatele v AI a skutečná důvěryhodnost systému jsou dvě různé věci, které se obě mění v čase. Přehledová studie Liebherra, Enkel a Law formalizuje koncept calibrated trust a ukazuje, proč jednorázový onboarding nemůže nahradit kontinuální kalibraci. Nadměrná i nedostatečná důvěra jsou stejně nebezpečné, ale vyžadují odlišné intervence.

✅ Peer-reviewed · Publikováno 2026 · Data sbírána [N/A, přehledová studie] · International Journal on Software Tools for Technology Transfer (Springer)

Co studie zjistila

Většina současných přístupů pracuje s důvěrou v AI jako s binární proměnnou: buď uživatel systému věří, nebo ne. Liebherr, Enkel a Law z University of Duisburg-Essen a University of Waterloo argumentují, že toto zjednodušení je zásadní chyba. Na základě přehledu existující literatury formalizují tři klíčové koncepty: trust (subjektivní přesvědčení uživatele, že systém bude v dané situaci užitečný a bezpečný), trustworthiness (objektivní vlastnost systému na straně technologie) a calibrated trust (stav, kdy se subjektivní důvěra shoduje s objektivní důvěryhodností).

Klíčový insight studie: všechny tři koncepty jsou dynamické. Systém se aktualizuje, kontext se mění, uživatel získává nové zkušenosti. Kalibrace, která fungovala v pondělí, nemusí platit v pátek. Paper systematicky mapuje metriky používané v literatuře pro měření trustu (dotazníky, behaviorální indikátory, psychofyziologické signály) i trustworthiness (technické benchmarky, safety audity, transparency skóre) a identifikuje, kde současné přístupy selhávají: většina nástrojů měří trust nebo trustworthiness izolovaně, ale málokdy jejich vzájemný alignment.

📚 Calibrated trust (Lee & See, 2004)

Koncept poprvé formalizovaný v kontextu automatizace. Kalibrace důvěry nastává, když míra důvěry uživatele odpovídá skutečné spolehlivosti systému. Pokud uživatel důvěřuje víc, než systém zaslouží, jde o over-trust (nadměrnou důvěru). Pokud důvěřuje méně, jde o under-trust (nedostatečnou důvěru). Lee a See ve svém vlivném frameworku z roku 2004 ukázali, že kalibrace závisí na třech faktorech: výkonnosti systému, procesu (jak systém funguje) a účelu (proč byl vytvořen). Liebherr a kol. tento framework rozšiřují o temporální dimenzi: kalibrace není jednorázový akt, ale kontinuální proces.

Studie rovněž kategorizuje příčiny, které ovlivňují dynamiku trustu. Na straně over-trustu identifikuje automation bias (tendenci přijímat výstupy automatizovaného systému bez kritického zhodnocení), pozitivní první dojem a vysokou pracovní zátěž, která snižuje kapacitu pro kritické posouzení. Na straně under-trustu mapuje předchozí negativní zkušenosti, nízkou technologickou gramotnost a mediální narativ o selhání AI. Důležitě: obě formy miscalibration mají odlišné důsledky a vyžadují odlišné intervenční strategie.

Jak to zjistili

Jde o přehledovou studii (review), nikoliv o empirický výzkum s vlastním sběrem dat. Autoři systematicky analyzovali existující literaturu k trustu, trustworthiness a jejich kalibraci v kontextu AI systémů. Paper je strukturován do tří hlavních sekcí: definice a formalizace konceptů (Sekce 2), přehled metrik a jejich limitací (Sekce 3) a analýza příčin ovlivňujících dynamiku trustu a trustworthiness (Sekce 4).

🔍 Přehledová studie (review paper)

Na rozdíl od empirických studií, které sbírají nová data, přehledová studie syntetizuje a kriticky hodnotí existující výzkum v dané oblasti. Její hodnota spočívá v mapování stavu poznání, identifikaci mezer a formalizaci konceptů. V hierarchii evidence stojí systematická review vysoko, protože agreguje poznatky z mnoha jednotlivých studií. Liebherr a kol. kombinují narativní a koncepční přístup: nejen shrnují, ale formalizují definice a navrhují metriky.

Autorský tým je interdisciplinární. Magnus Liebherr vede skupinu Human-Factors and Cognition na University of Duisburg-Essen a propojuje kognitivní psychologii s inženýrstvím. Ellen Enkel je profesorka Business Administration and Mobility na téže univerzitě, jedna z nejcitovanějších výzkumnic v oblasti inovačního managementu (top 2 % podle Stanfordského žebříčku). E.L.C. Law přináší perspektivu human-computer interaction z University of Waterloo. Tato kombinace psychologie, inženýrství a HCI odpovídá povaze problému: kalibrace důvěry je ze své podstaty multidisciplinární.

Proč je to důležité

Studie přichází v momentě, kdy AI systémy přecházejí z izolovaných nástrojů na integrované pracovní partnery. Agentic AI, kteří autonomně vykonávají úkoly, dělají problém kalibrace naléhavějším: uživatel musí důvěřovat nejen výstupu, ale celému rozhodovacímu procesu, který nevidí. A jak ukazuje Liebherr a kol., tato důvěra se musí dynamicky přizpůsobovat, protože se mění jak schopnosti systému (update modelu, nové skills), tak kontext použití (nové úkoly, jiné prostředí) i uživatel sám (roste zkušenost, mění se expectation).

📚 Automation bias (Parasuraman & Riley, 1997)

Tendence nadměrně důvěřovat automatizovaným systémům, i když chybují. Projevuje se dvěma způsoby: pasivním (uživatel si nevšimne chyby systému) a aktivním (uživatel chybu vidí, ale věří systému víc než vlastnímu úsudku). V kontextu generativní AI je automation bias obzvlášť zákeřný: čím přesvědčivěji systém komunikuje, tím silnější tendence k nekritickému přijetí. Parasuraman a Riley ve své vlivné práci z roku 1997 upozornili, že jde o systémový problém designu, ne o individuální selhání uživatele.

Pro evropský kontext je studie relevantní i z regulačního pohledu. EU AI Act vyžaduje „human oversight" u vysoce rizikových AI systémů, ale Liebherr a kol. implicitně ukazují, že samotná přítomnost člověka v loopu nestačí. Pokud je důvěra špatně kalibrovaná, člověk buď slepě přijímá výstupy AI (over-trust), nebo je systematicky odmítá (under-trust). Efektivní oversight vyžaduje mechanismy pro kontinuální kalibraci, nikoliv jednorázový trénink.

Formalizace metrik je prakticky užitečná i pro designéry AI systémů. Místo otázky „důvěřuje nám uživatel?" by měli klást otázku „je důvěra uživatele kalibrovaná vzhledem k aktuálním schopnostem systému?". To je fundamentálně jiný design challenge.

Limity a otevřené otázky

Jako přehledová studie je paper limitován kvalitou a rozsahem syntetizované literatury. Autoři formalizují koncepty a navrhují metriky, ale neposkytují empirickou validaci těchto metrik na reálných systémech. Framework je primárně koncepční. Přechod od formalizace k implementovatelným nástrojům zůstává otevřenou výzvou.

Paper neposkytuje specifické informace o období sběru analyzované literatury. Vzhledem k dynamice oboru AI, kde se landscape mění v řádu měsíců, by bylo užitečné vědět, jak aktuální jsou syntetizované zdroje.

Studie se zaměřuje primárně na individuální úroveň (uživatel vs. systém). Sociální dimenze trustu, tedy jak důvěra jednoho uživatele ovlivňuje důvěru ostatních, mediální narativy o AI, nebo organizační kultura kolem AI, zůstává relativně nepokrytá. Přitom právě sociální context může být dominantní silou v kalibraci důvěry.

Zdroje:

- Liebherr, M., Enkel, E., Law, E.L.C. et al. (2026). Dynamic calibration of trust and trustworthiness in AI-enabled systems. Int. Journal on Software Tools for Technology Transfer, Springer.

- Okamura, K., & Yamada, S. (2020). Adaptive trust calibration for human-AI collaboration. PLoS ONE.

- Choung, H. et al. (2024). Trust in AI: progress, challenges, and future directions. Humanities and Social Sciences Communications.